转帖

背景

欧洲原子能研究机构CERN

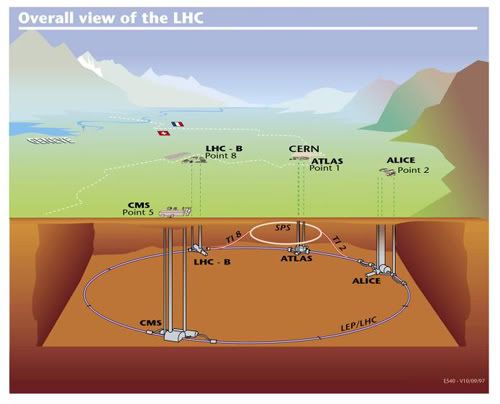

欧洲原子能研究机构CERN成立于1954年,是世界最大的粒子物理研究中心。CERN是欧洲第一个联合研究机构,由20个成员国提供资金,其卓越成绩已经成为国际合作的典范[43]。CERN位于法国和瑞士的交界处,就在日内瓦的郊区。CERN主要研究物质是怎样构成的,以及是什么把它们结合起来的。CERN建有世界上最大的正负电子对撞机LEP(Large Electron-Positron collider)和超级质子同步加速器SPS(Super Proton Synchrotron),如图 4‑1所示,大圆是LEP,周长达到27公里,粒子能够加速到每秒运动11000周,接近光速。小圆是SPS。与加速器配套的是四层楼高的粒子检测器,用于对粒子性质进行分析。

图 4‑1 CERN(大圆为LEP,小圆为SPS)

来自全世界80多个国家、500多所大学及研究机构的6500多名科学家(占全球粒子物理学家的一半)在CERN进行各种各样的实验。CERN自身拥有各种各样的技术支持人员,包括物理学家、工程师、程序员、技术人员、管理人员、工人等,他们负责建立各种复杂的设施并保障其正常运转。在CERN完成的实验也是前所未有的,通常需要数百名科学家在巨大的设备上共同完成,一个实验昼夜不停,持续数月乃至数年。

顺便说一句,CERN同时也是寰球网WWW(World Wide Web)的发源地[44]。1990年,CERN的计算机科学家Tim Berners-Lee,为了方便分布于世界各地的高能物理学家之间的协作,设想和开发了WWW客户端和服务器端,还定义了URL、HTTP、HTML等。正是由于Tim等人的贡献,Internet才变成了大家今天所习惯的模样。

大型强子对撞机LHC

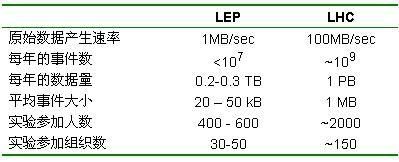

目前CERN有1800名物理学家正在为下一代全新的加速装置作实验准备。该装置称为大型强子对撞机LHC(Large Hadron Collider),将于2005年投入使用,这将是人类历史上最强大的粒子加速器[45]。未来在LHC上进行的实验的参加单位、人数及产生的数据量也是前所未有的,这一点可以从LHC与LEP的对比看出来(表格 4‑1[46])。做个类比,LHC将要产生的数据量,将是目前CERN所有设备产生的数据量的总和还要多一到两个数量级。

表格 4‑1 LEP与LHC的对比

DataGrid

LHC的出现将给计算科技带来全新的挑战,为此,需要有空前的计算能力来处理这些数据,空前的人类智慧来分析这些数据,以及空前的存贮能力来保存这些数据。解决这些问题的基本思想是把海量数据分散到全球的计算机上进行处理,并由全球的物理学家共同分析之。在这个背景下,欧洲的数据网格DataGrid应运而生了,它成为实现这个“大科学”目标的基础平台。

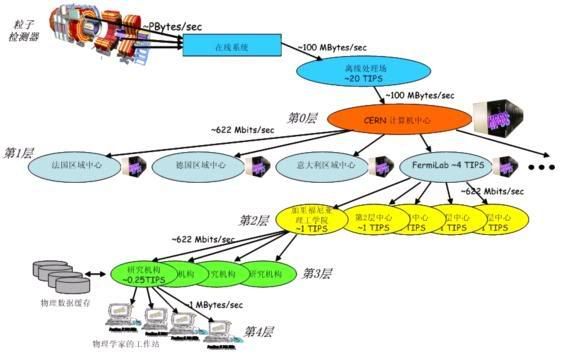

图 4‑2 DataGrid的分布处理策略

DataGrid对海量数据的分解过程如图 4‑2 [47]所示。粒子检测器产生的原始数据具有PB/s量级,经过在线系统过滤后,并经具有20万亿次处理能力的离线处理场的处理,最终以大约100MB/s的速率永久写入磁带,这个100MB/s 就是DataGrid真正需要处理的数据速率。CERN计算机中心负责将这些数据通过高速网络分配给欧洲、北美、日本等国的区域中心,后者再将任务作进一步分解,到物理学家的桌面时,数据量只有1MB/s,已经可以很方便地进行处理了。

DataGrid需要解决许多问题,诸如[46]:

1、DataGrid需要管理成千上万个处理器和磁盘、千万亿字节(PB)的数据和每秒万亿比特(Tb/s)的网络带宽,面对如此复杂的系统,如何才能保证它的高可扩展性、低成本和易管理性?

2、广域网的带宽只是局域网的1%-10%,不同的研究机构有不同的管理者和管理政策,如何保证数量要在它们之间安全地分发、复制、缓存并保持同步和完整性?

3、如果才能协调好不同国籍、不同研究机构的科学工作者的工作,使他们及时分析数据并汇总结果?

这些问题解决好了,不仅对于在LHC上开展的实验是至关重要的,对于其他领域的研究也具有指导意义。可以这样说,虽然在高性能计算机、集群、网格等领域里美国一直处于领先地位,但欧洲的CERN所开创的大科学研究是美国难以望其项背的。

DataGrid的设计

DataGrid负责人Gagliardi这样描述DataGrid所要完成的工作[48]:

当用户提交一个任务时,DataGrid首先分析完成任务所需要的计算资源。然后,找到这些资源并分配给任务。同样地,运行任务所需要的数据也被检索出来并传送给计算资源。在这个过程中,DataGrid需要具备:分析任务的能力,随时掌握网格中资源的能力,执行任务程序的能力,任意传输数据的能力,判定和保障服务质量的能力,从错误中恢复的能力,记录出错情况的能力,等等。

论文[45]分析了DataGrid所应具备的主要功能:

1、负载调度和管理

DataGrid在管理负载时所面临的新问题有:数据经常需要动态重新分配,系统中可调度组件的数量非常之大,会出现许多用户同时提交任务的情况,不同国家不同机构有不同的管理策略,等等。负载管理在分解和分发任务时,必须基于计算能力和数据的可用性。为此,需要扩展作业描述语言,使之能够描述数据的相关性。负载管理应能比较不同任务分解方法的利弊,为此,它需要预测并综合考虑任务在不同机器的执行时延、生成数据缓存副本的开销、在二级存贮和第三方存贮之间迁移数据的开销,等等。更进一步,负载管理应该有新手段支持资源的协同分配和预留,以及在组件失效时的恢复策略。

2、数据管理

DataGrid需要开发中间件以支持对海量数据的访问,既要有统一的名字空间和统一的数据格式,又要能在不同站点之间高速移动和复制数据,还要保持远程数据拷贝的一致性,等等。DataGrid应该有一些优化措施,支持自动的广域网数据高速缓存机制,并能根据用户的使用模式选择数据的分发方式。

3、网格监控

DataGrid需要有监控网格运行的窗口,它既能站在一定高度纵览全局,又能深入某个局部分析细节状况,为此,需要开发底层API,提供对计算构件、网络和海量存贮的性能和状态信息。有了这些支持,就能协助制定工作负载和数据管理的调度策略,以及调整应用程序的运行性能。

4、构造层的管理

网格的构造层(fabric)是网格存在的物理实体,没有它们,就谈不上计算和存贮,谈不上资源的可用性和性能,谈不上安全认证,谈不上资源分配。为此,需要有创新性的中间件,对所有的基础构件提供灵活和有弹性的管理。虽然现有网格的研究成果(如Globus)本身就具有动态配置、自动容错、自适应资源变化以及自动调整性能特性的能力,但对于DataGrid所要面临的问题而言,这些能力就显得不够强了,它不仅要面对成千上万个基础构件,还要满足严格的时间约束条件,必须要有创新性方法,实现自动发现和隔离错误、自动重组构造层、自动重新运行任务、自动把新加入的系统带入基础设施中。

5、海量存贮管理

粒子物理处理大规模数据已经有几十年的经验了。然而,在过去的一些年里,由于每一个加速器中心都有各自的数据格式,不同格式之间的转换给CERN的合作数据处理机构带来了许多麻烦。DataGrid应该提供数据之间的转换接口,同时它还要负责将本地的海量数据存贮系统集成到网格的数据管理系统中。换言之, DataGrid要用统一的接口屏蔽不同站点的数据存贮方式和处理方式之间的差异,使分布的存贮资源能够无缝融合。DataGrid的体系结构[50]如下所示。由于DataGrid尚在研制过程中,它还不是最终版本。

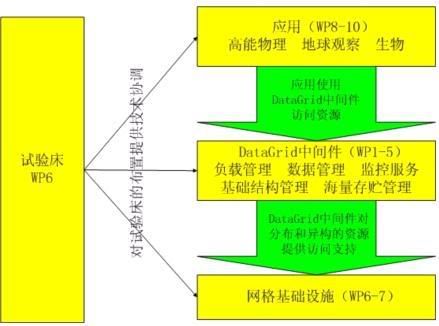

图 4‑3 DataGrid的体系结构

需要指出的是,DataGrid的体系结构与Globus的体系结构息息相关,它的规划需要充分考虑与Globus配合的要求;从Globus的角度看,它原本是针对计算网格而设计的,但Globus项目组好像非常想把它变成一个通用的网格平台——这也是未来的Globus 3.0叫做开放网格服务体系结构OGSA(Open Grid Service Architecture)的原因——为此,Globus项目组也为让它提供数据网格服务做了许多工作,感兴趣的读者可以参考[52][53][54]。

DataGrid的项目管理

欧洲DataGrid于2000年12月29日正式立项,由欧盟提供980万欧元资金,项目完成期限为3年。项目主要完成者除了CERN外,还有法国国家科学研究中心CNRS(French National Centre of Scientific Research)、 欧洲空间研究中心意大利分部ESA/ESRIN(Centre of the European Spatial Agency in Italy)、意大利国家原子物理研究所INFN(Italian National Institute of Nuclear Physics)、荷兰国家原子物理和高能研究所NIKHEF(Dutch National Institute of Nuclear Physics and High Energies)和英国粒子物理和天文研究委员会PPARC(British Council of Research in Particle Physics and Astronomy)。除了这六家外,还与其他十几家研究机构和工业界建立了合作研究协议[48]。

这样一个多个国家共同参与、规模庞大的网格项目,如何协调不同研究机构的关系,如何保障研究进度,如何简化研究的对象,一定需要有独到的考虑,而这些考虑对于我国正在建设或准备建设的一些网格项目,无疑是有借鉴意义的。

1、明确应用背景

DataGrid主要针对CERN的高能物理应用,解决海量数据的分解存贮和处理问题,同时将之扩展到其他应用,如地球观察应用和生物应用,并寻找将其推广的可能。可以说,CERN的应用,特别是未来的LHC应用,是DataGrid的立足之本。解决好这个应用,DataGrid的研究就可以取得战略性胜利。一句话,有应用背景的项目才有生命力,这点特别值得我们重视。

2、站在巨人的肩上

进行DataGrid的研究,有两个选择:一个是从头到尾,完成全新的数据网格中间件,不借助第三方的网格平台;另一个选择是基于Globus,在其基础上扩展数据网格所特有的中间件代码。虽然这个问题看似简单,但国内的确有些研究人员喜欢从头开始(start from scratch),前些年甚至有人试图重写TCP/IP的IP层代码——精神可嘉,但未必是好的选择,有这么旺盛的研究精力,应该投向更容易出成果的领域。DataGrid毫不犹豫地选择了基于Globus平台。试想,Globus已经完成了DataGrid所要解决的80%的网格问题,这样,DataGrid就可以专心解决好剩下的20%的问题,这样成功的把握性要大得多。除了与Globus项目组织联合开展研究外,DataGrid甚至与美国的“竞争对手”GriPhyN[51]建立了合作关系。GriPhyN是一个与DataGrid类似的物理数据网格。

3、分而治之

将复杂任务分解为相对独立的模块,这是软件工程中常用的手段,在DataGrid中也不例外: DataGrid的任务划分成为12个工作包WP(Work Package),分为五组,如表格 4‑2所示。

表格 4‑2 DataGrid开发任务分配

这些工作组之间既相互独立,又相互依存,如图 4‑4[49]所示。工作组WP11和WP12专门负责整体协调,既保障WP1-10能够正常运转,又负责与其他研究机构的协作。

图 4‑4 DataGrid项目工作包的技术配合

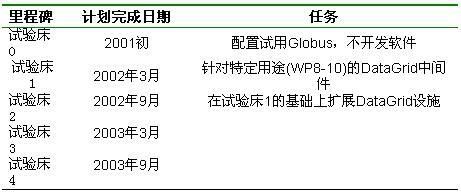

4、里程碑式渐近开发

将时间划分成相对独立的阶段,简化每一阶段所要面对的问题,相当于再次将问题简化(如表格 4‑3所示)。

表格 4‑3 DataGrid开发计划

5、多种协调手段

DataGrid项目通过一组网站协调不同工作组(WP)之间的研究和进度,并保持与其他研究机构和工业界的同步。这些网站同时也是共享、交流研究成果的平台:每个工作组有各自的主页,可供发布新闻,或将已经开发好的软件提供下载。另外,各个工作组或整个项目经常定期或不定期召开会议,还要按计划在每个阶段向欧盟报告进度和进行演示。

参考文献

[43] CERN in 2 minutes,

http://public.web.cern.ch/Public/whatiscern.html

[44] The World Wide Web,

http://public.web.cern.ch/Public/ACHIEVEMENTS/web.html

[45] Ben Segal, Grid Computing: The European Data Project, IEEE Nuclear Science Symposium and Medical Imaging Conference, Lyon, 15-20 October 2000.

[46] Ben Segal, The European DataGrid project, First Presentation At Data Mining Workshop-CSC Scientific Computing - Otaniemi 05-APR-01,

http://web.datagrid.cnr.it/pls/portal30/docs/902.PDF

[47] GRIDS Center: Grid Research Integration Development & Support,

http://www.grids-center.org/Net2002%20Talk%204-18-02.ppt

[48] First results and future perspectives of the European DataGrid project,

http://www.hoise.com/primeur/02/ ... AE-PR-04-02-22.html

[49] Project Description,

http://web.datagrid.cnr.it/servlet/page?_pageid=873,875&_dad=portal30&_schema=PORTAL30&_mode=3

[50] Robert Jones, Status of EU DataGrid project and test-bed 1, First Presentation At 2nd NorduGrid, Oslo, Norway 01-NOV-01,

http://web.datagrid.cnr.it/pls/portal30/docs/2048.PPT

[51] Grid Physics Network,

http://www.griphyn.org

[52] S. Vazhkudai, S. Tuecke, I. Foster. Replica Selection in the Globus Data Grid. Proceedings of the First IEEE/ACM International Conference on Cluster Computing and the Grid (CCGRID 2001), pp. 106-113, IEEE Computer Society Press, May 2001.

[53] H. Stockinger, A. Samar, B. Allcock, I. Foster, K. Holtman, B. Tierney. File and Object Replication in Data Grids. Proceedings of the Tenth International Symposium on High Performance Distributed Computing (HPDC-10), IEEE Press, August 2001.

[54] W. Allcock, A. Chervenak, I. Foster, C. Kesselman, C. Salisbury, S. Tuecke. The Data Grid: Towards an Architecture for the Distributed Management and Analysis of Large Scientific Datasets. Journal of Network and Computer Applications, 23:187-200, 2001.

作者介绍 刘鹏,清华大学计算机系 高性能所网格研究组博士研究生,IEEE、GGF、CGF会员。个人主页:

http://hpclab.cs.tsinghua.edu.cn/~pengliu/。

(责任编辑:铭铭)

LHC 详细说明

http://boinc.equn.com/lhc/LHC/lhc.html

别具一格的工具

大型强子对撞机(LHC)是一台粒子加速器。它建造在 CERN。CERN(欧洲核子研究中心)是目前世界上最大的物理实验室。当 2007 年时,LHC 将全面启用。届时,它将会是全世界最强的粒子研究工具。

LHC 将会代替 LEP(大型正负电子对撞机)。它将坐落在 100m 的地下一条 27km 长的隧道里。它能将两束质子加速到 7 特电子伏的能量,然后发生碰撞。质子碰撞所产生的能量将会有 14 特电子伏。但 LHC 也不会限制质子与相对较重的离子的碰撞。他们的碰撞还能产生 1148 特电子伏的能量。

LHC 全景示意图

在向 LHC 注入之前,质子速将存放在 CERN 现有的加速器复合体 里。这是一个机器的附带装置,里面有不断增加的能量。每次将质子束注入后,出来的将具有更高能量。

CERN 加速器复合体

LHC 必须拥有能制造 8.36 特斯拉的磁场,才能把带有 7 特电子伏能量的质子的轨道弯曲成环状。这就要应用超导的性质。超导性是特定物质的一种性质,在极低的温度下它们的电阻会消失。LHC 将会在比室温低 300 度的环境下工作(甚至比外太空更冷!)。LHC 的实验使用最高科技的加速器、超导电磁铁等。1296 块超导电磁铁和超过 2500 块的其它磁铁将引导质子束的运行方向和使它们产生碰撞。它们之中有各种各样的磁铁,有大的,小的,有超导电的,调焦的,还有四极的。当 LHC 竣工以后,它将会是世界上最大的超导电设备。

五项实验都配有检电器。它们将质子束碰撞时的信息记录下来并传送给我们。它们将处理比现在整个欧洲通讯网络信息量还大的数据。

为什么我们需要 LHC ?

因为我们现在对宇宙的认识还不完整。

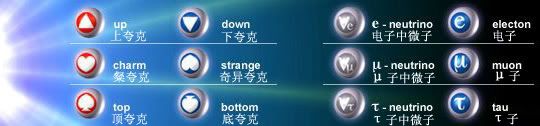

在过去一个世纪中,众多物理学家的理论和发现揭示了粒子与力的标准模型这一个描述物质基本结构的图景。在现在,标准模型已经被广泛验证,并被应用于解释并预言广泛的物理现象。不断重复的精确实验出来的结果与标准模型的预言精确匹配。不过,由于它还留下了很多未解之谜,所以,故事远未完结。

在这些疑惑当中,最令人困惑的是:为什么基本粒子会有各自不同的质量呢?由于我们对这个如此简单的观念的理解如此的少,所以这个问题实在引人注目。这个问题的答案可能就是标准模型中一个叫“希格斯机制”的思想。根据这个思想,整个空间被一个所谓的“希格斯场”所充满,粒子通过与这个场相互作用而获得质量。与希格斯场相互作用强的质量就大,反之质量就小。这个希格斯场至少联系一个新的粒子,我们叫它希格斯玻色子。如果这样的粒子存在的话,LHC 就可以探测到它。

另一个疑问是关于四种力为何存在的。当宇宙诞生不久,还没变冷的时候,可能四种力的行为是一样的。粒子物理学家希望找到一个单一的理论体系来证明它,现在已经有了一定的进展。在 19 世纪 70 年代,电磁力和弱力已经被统一为一个单一的理论。几年以后,这个理论被一场在 CERN 举行的、后来获得诺贝尔奖的实验所证实。但是,四种力中强度最弱的引力和强度最强的强力还是水火不相容。力的统一暗示的一个流行的观点就是超对称(简称 SUSY)。超对称预言,每一个已知粒子都有它的超对称“伙伴”。如果超对称是正确的,那么这些超对称粒子应该会在LHC中被找到。

反物质给我们出了另一个谜,LHC 能够帮助我们解答它。我们曾经一度认为反物质是物质的完美镜像。如果你将物质替换成反物质,然后在镜子中观看结果,你不会察觉与正常的有何不同。现在我们知道,这种镜像是不完美的,这就导致了物质与反物质之间的不平衡。LHC 会成为一个很好的“反物质镜子”,能让我们用至今最严酷的实验来检验标准模型。

这只是LHC能够回答的一些问题。历史证明,最伟大的科学进步往往是无法预料的。尽管我们有一个建造LHC的绝佳理由,但自然总是出人意料的。

有一件事是确定的,就是LHC会改变我们对宇宙的看法。

LHC 的运转

由于需要同时对两束粒子进行加速,LHC 实际上是一台“二合一”的机器。它将会包括被包裹在同一个套子和低温保持器里边的两套超导磁铁隧道(环)。这种独特的构造不但节省空间,而且帮我们节约了经费的 25%!

两个环会被超级质子同步加速器(SPS)送出的预加速到 0.45 特电子伏的质子所充满,然后将这些质子加速到接近光速,拥有 7 特电子伏的能量。

我们所说的“质子束”实际上是连续的许多被压缩的质子群。这两个 LHC 的粒子束会有 2853 个含有 1001 个粒子的群组成。

一旦能量达到 7 特电子伏,两束粒子束会进行长达几小时的反向绕行。在这段时间里边,粒子会在 LHC 中作 4 亿次绕行。这真的是一个天文数字。

在每一圈,粒子束会被强迫在指定的、放有探测器的地点碰撞。

在 10 小时以后,粒子束会丧失大部分能量,所以 LHC 必须重新清空并注入粒子。

技术挑战

重要参数

在 LHC 中,质子碰撞所产生的能量可以达到 14 特电子伏特,是以往的加速器的 10 倍。但是,仅仅只有能量是远远不够的。如果要想保证一个有效的实验,比如说完成 LHC 所计划的探索,还需要考虑一个很重要的参数:亮度。

碰撞的亮度是与每秒钟碰撞次数成正比的。然而,在以往的加速器中的碰撞亮度最多达到 L = 1032cm-2 s-1 ,在 LHC 亮度可以达到 L = 1034cm-2 s-1 。在每个环中注入 2835 群含有 1011 个粒子就可以达到这一点。

这种前所未有的能量和亮度给设计与运行带来了严酷的考验。

干扰效应

当粒子正在环行 4 亿圈时,有几种效应会使粒子束变弱,亮度变暗。让我们来看一下几个主要问题,以及 CERN 的科学家如何试着解决它们。

粒子束效应

当两群粒子在一个物理探测器中间相遇时,只有一小部分的粒子会迎头相撞,产生我们想要的结果。其他粒子会被反向的群的电磁力推偏离。这种偏离,对密集的粒子群效应更大。如果在每一圈的偏离都累积起来,很可能会导致意外的粒子损失。这种粒子束效应已经在以前的加速器中被研究过。实验表明,我们如果想使粒子束保存实验所需的更长的时间,粒子束的密度就不能超过一个极限。为了达到我们想要的亮度,LHC 需要尽可能地靠近这个极限。

集体不稳定性

当在 27 千米的 LHC 管道中以接近光速运行时,每一个质子群都会留下一个影响下一群粒子的电磁场。这可能会导致粒子束的丧失。这种集体不稳定性在 LHC 中会变得更严重,因为为了达到更高的亮度,我们需要更大的粒子束。仔细地控制在粒子束周围的元素的电磁属性与利用改进了的反馈系统可以将这种效应减到最低。

混沌运动

除了已经提到的粒子束效应以外,引导以及聚焦的电磁场如果稍微与线性预定有偏离的话,会导致粒子束有混沌效应。这样的话,在许多次环行后,粒子可能会丢失。

在 LHC 中,粒子注入能量中,不完美的电磁场产生的不稳定效应更为明显,因为缺陷的程度更大,粒子束占据环绕横截面的一个更大的部分。

解决它有两种途径:

1、我们必须估计动态孔(在要求时间内粒子束能保持稳定的环绕横截面部分)的大小,保证它比注入的粒子束横截面更大,并留下一道足够安全的边沿。

2、直到现在,还没有一个理论能充分精确地预言在非线性场中粒子束的长期行为。所以,我们用计算机模拟追踪数以百计的粒子一步步穿过 LHC 的磁铁上百万圈。模拟结果被用来确定在设计以及制造中电磁铁质量的可以容忍的偏差。

您能够在这里帮助我们!参加 LHC@home ,运行 SixTrack 程序,帮助科学家们对付混沌运动的影响!

熄灭

不管怎么细心,粒子束的寿命不会是无限的。也就是说,一部分粒子会散射到管壁并且丢失。在这种情况下,粒子的能量会在周围的金属材料中转化成热,又可能会导致需要低温的超导电磁铁“熄灭”。在 LHC 中 5000 个超导磁铁的任一个的熄灭,都会使机器的运行中断几个小时。为了避免这样的事情,一个瞄准系统会在不稳定的粒子碰到管壁之前捕获它们,从而限制在远离超导电磁铁的隔离区域内的损失。为了设计更有效的控制系统,安全工程师们正在用先进的电脑程序去研究耦合的磁铁受一次“熄灭”产生的热量的影响的分析。

SixTrack (LHC@home 项目所使用的计算程序)

LHC(大型强子对撞机)实验所需要的科学计算大多都需要对海量的数据进行检索——LHC 每年都会产生 15PB(即 15360GB)的数据。这种规模的数据需求意味着绝大多数的数据分析程序不能在个人电脑上运行。这就是为什么 CERN(欧洲粒子研究所)正在带头开发将世界各地的主要计算中心连接起来的计算网格。

然而,公开的计算也有可能会对 LHC 项目产生特殊的意义。CERN 的网络技术部对评估像 SETI@home 这种分布式计算技术是否在将来有用处很感兴趣。一个叫 SixTrack 的,旨在模拟粒子在 LHC 中运行以研究 LHC 的稳定性的程序,可以在个人电脑上运行,而且只需要相对较少的输入输出量。

SixTrack 是由 CERN 加速器与粒子束部门的 Frank Schmidt 开发的。它基于一个早期在 DESY(德国电子同步加速器,位于汉堡)开发的程序。它计算校检 LHC 中运行的高能粒子束的长期稳定性所必需的数据。LHC 的总负责人 Lyn Evans 说:“Sixtrack 返回的数据真的很紧要,它让我们能够洞察将来LHC的运行情况。”

Sixtrack 一般每次模拟 60 个粒子绕加速器环运行 100000(有时可能达到 1000000)圈的运行情况。这好像是很多次运行,但在真实世界中它们只需要不到10秒的时间。但这还是足以检验到底粒子束是在长时间内保持稳定的运行,还是会有失去控制撞击真空管壁的危险。这样的粒子束的不稳定性是一个很严重的问题,可能会导致加速器由于损坏而停止。

重复上千次这样的计算,我们就可以知道加速器中的粒子束的稳定运行路径等等情况。

粒子在稳定轨道(图左)和不稳定的混乱轨道(图右)中的相空间图像。这个相空间图画出了每个粒子返回情况所代表的点。对于稳定的粒子,它的相空间是整个相空间的有限的一部分。而对于不稳定的粒子,它的相空间倾向于填满整个可能的相空间。在某些点,不稳定的粒子甚至会完全地离开轨道,导致粒子束被破坏。

LHC@home 项目介绍

LHC@home

现在,LHC@home 能够在 Windows 和 Linux 等操作系统上运行,但我们希望尽可能在近期内借助测试者们的帮助,把它拓展到其它平台上。(特别鸣谢 Robert Virga,他作为一位测试者,开发了在 Linux 平台上 LHC@home 屏保的一个图形包。)

Windows 上的屏保程序模拟一批类似于计算程序(SixTrack)模拟的粒子。但是,屏保模拟的粒子运动是由一个与 Sixtrack(模拟 LHC 的主程序)完全独立的算法决定的。但我们正打算推出一个展示代表 Sixtrack 正在模拟的粒子束中的粒子的屏幕保护。

LHC@home 屏幕保护

在 2005 年三月,一些巨大的偶极超导电磁铁被安装在 LHC 的隧道中。每一块电磁铁被安装后,工作人员就对其进行测量以获取其参数。如果这些参数与规定值有较大的偏离,我们就需要运行 SixTrack 来研究这会对 LHC 的运行有什么影响。对需要将 1232 块超导电磁铁单独安装在 LHC 上的工程师来说,获取模拟的结果至关重要。所以说,您对 LHC@home 的参与真的能够帮助我们建成 LHC !

LHC@home 项目历史

LHC@home 项目历史

2003年,CERN(欧洲粒子物理研究所) IT 部门的 Eric McIntosh 和 Andreas Wagner 展开对一款名为 Compact Physics Screen Saver (CPSS) 的屏保的测试。在屏幕保护的同时运行 SixTrack 。CPSS 被视为是一个分布式计算工作重要工具。今天,在 CERN 使用 CPSS 的计算机一远不只 200 台。不同的 PC 可以分析不同的 WU 。Eric McIntosh 利用严密的数学函数,解决了在不同计算机上所出现的问题。

2004年1月,Ben Segal 和 François Grey 被任命在 CERN 的五十周年庆典之际,把分布式计算以及 LHC 推向全世界。他们接触到 SETI@HOME 的主管 Dave Anderson。那时,Anderson 先生正在测试新的 BOINC 平台。与此同时,一些丹麦学生找到了 François Grey ,他们十分热衷于参加此计划,因为这对于他们的硕士论文十分有用。这就是 LHC@home 的开始。Christian Søttrup 和 Jakob Pedersen 用整个春天和夏天的时间,试图把 SixTrack 和 BOINC 平台衔接起来。他们简直是典型的工作狂。您能从他们的文章中,找到关于分布式计算像 LHC@home 的描述。

这些为CERN工作人员,左起

Frank Schmidt(AB成员),Jukka Klem(赫尔辛基物理协会成员), Andreas Wagner,Eric McIntosh,and Ben Segal (CERN IT部门)。

2004 年夏天以后,一位来自 Berkeley(伯克利大学)的学生 Karl Chen 前来帮助 Christian 和 Jacob 与 BOINC 方面的人员一起工作。他曾和Dave Anderson 共事。一位来自 Basel(瑞士巴塞尔大学)的学生 Jasenko Zivanov 对 CPSS 的屏保画面做了修改。两位从赫尔辛基物理协会的计划中毕业的学生轮流负责对 BOINC 服务器的设置和管理工作。随着 LHC@home 顺利通过第一和第二阶段的调试,程序终于在 9 月份和 BOINC 平台衔接成功。而这胜利的一天,正是 CERN 建立 50 周年的纪念日——九月二十九号。单在 10 月 16 号 CERN 开放日这一天,就有超过 30000 人次访问了 CERN 的站点。几个月以后,SixTrack 的用户超过了 6000 人。这被认为是服务器所能承受的最大吞吐量。

LHC@home 在数月的暂停之后,于 2005 年 2 月重新开始。对 LHC@home 用户的服务成为了 CERN IT 部门的主要工作。LHC@home 计划重新开始启动也是当年物理界的大事之一。Ignacio Reguero 正在管理此项目。他与 Phil Defert 和 Phil Defert 一起在 High Energy Physics community(高能物理研究协会)中寻找其他合作伙伴。目的是为了开发新的软件。Eric McIntosh 和 Frank Schmidt 继续为给用户提供数据和分析数据而努力工作。赫尔辛基物理协会在 CERN 科技计划的参与者 Jukka Klem 正在管理 24 小时工作的服务器,并负责发布项目新闻。

除了帮助建造 LHC 以外,LHC@home 也可以帮我们获得一些对分布式计算所面对的挑战的基本的洞察。无论在是 LHC@home 还是它的内部发行的前身 CPSS 中,我们都发现不同的处理器可能会产生显著不同的结果。这是因为在不同的处理器中,一些数学运算,比如说指数运算和正切运算的舍入,是不同的。由于缺乏一个统一的国际标准,所以在不同处理器中会有微小的误差。又由于 SixTrack 模拟的粒子束的运动是一种浑沌的运动, SixTrack 会把不同处理器间的微小误差放大成为引人注目的不同结果。尽管最初我们遇到了这个在程序初始化时的问题,但我们已经用位于 Lyon 的 Ecole Nationale Supérieure 中的一个群队最新开发的函数库解决了它。这个结果给了现在正在开发的、将要在一大类不同的计算机上运行的网格计算应用程序一个潜在的启示。

物理学家们为什么需要粒子加速器?

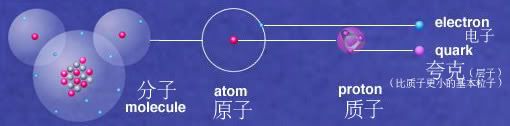

科学家们已经发现宇宙中所有的东西都是由基本粒子组成的。这些物质被一些基本的力量所支配。

一些粒子(如电子)是稳定的,它们组成了通常的物质。另外一方面,一些粒子(如 μ 轻子)在衰变,变成相对稳定的粒子之前只存在很短的时间。还有一些粒子(如 Higgs 玻色子)被认为在大爆炸以后会瞬间消亡。但我们仍未有在宇宙中找到此类粒子。

巨大的能量在粒子碰撞的一瞬间喷发。粒子加速器可以模拟早期的宇宙,在粒子都衰退成相对稳定的一类之前,在极短的时间内生成 Higgs 玻色子。碰撞后,相对稳定的粒子留下的 信号痕迹会由粒子加速器碰撞区周围的检电器检测到。通过计算处理,科学家们可能得出发现新粒子的结论。

那样,研究粒子碰撞就像“检阅过去”,模拟早期的宇宙环境。

粒子加速器——精细的显微镜

人类通过光的反射认清世界(其它动物,像海豚和蝙蝠利用声波探测周围的环境)。实际上,从所有可以发出波的东西都可以得出有关环境的信息。使用波来探测物理世界的问题在于图像的质量被我们所可以看见的波长所限制了。

我们的眼睛探测到的光,波长一般在 0.4—0.8 微米(1 微米等于 0.000001 米或 10^-6 米)。这意味着我们的眼睛不能检测到波长超出这个范围的光波,也就是比这更小的东西,我们就很难发现了。自从我们不需要看到比 1 微米还小的东西时,比这个范围还要小的东西就不再被我们所察觉。

但是 CERN 的科学家们需要研究次原子级的问题,在那里,典型的尺寸是在飞米(0.000000000000001 米,即 10^-15 米)这个数量级上的,甚至更小!

在很久以前,人们发现移动的粒子也具有波的性质。由于粒子能量更高,故波长更短。这样,我们就能看到比微米还小的细节。若电子有足够大的能量,我们利用它来观测。这就是电子显微镜的原理。电子显微镜用在生物学和金属组织学的用途,用来观测细胞或金属的细节。然而,连最好的电子显微镜也不能照出一张清晰的原子照片。

由于所有粒子都具有波粒二象性,所以科学家就利用具有极短波长的粒子作为探针。我们需要粒子释放出十亿倍更强的能量。想要得到更细的信息,就需要建造更大的机器!

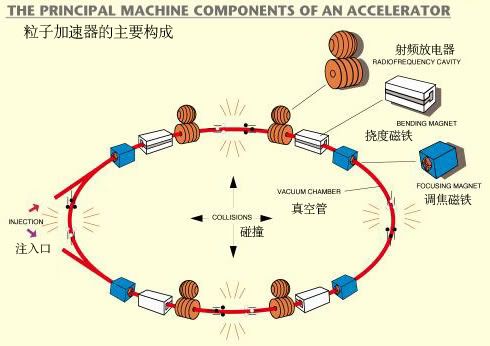

一台粒子加速器是怎样工作的?

一台粒子加速器通常由一个真空管、真空泵、磁铁、射频放电器、高电压的器械和线圈组成。每一个组成部分都有它准确的职能。

真空管 由金属管组成,里面将会被真空泵抽空。这是为了消除空气以及空气中其他粒子对粒子加速实验的影响。

射频放电器 在真空管内,粒子被电磁场加速,这是由射频放电器(RFC)发生的。每当粒子穿过射频放电器发生的磁场是,它们就会被加速,像被磁场提了一脚一样。粒子加速器把粒子束的加速轨道成为一个封闭的圈,使粒子束可以多次穿过磁场,这使 RFC 发挥更强效能。这就是为什么很多粒子加速器都是圆环形的原因。

磁铁 通常粒子束都可以通过弯曲轨道,到达磁铁的磁场。这些磁铁又被称作挠度磁铁。这是因为磁力使活跃的粒子总是保持匀速,这对于弯曲的轨道来说是完美的。粒子的能量越强,使粒子轨道弯曲的磁场就要越强。这就意味着磁场的强度是限制了的(常规的用 2 特斯拉超导电的甚至用 10 特斯拉)。机器更强,磁场要更大。

四极磁铁 在加速之余,我们也需要对粒子束进行调焦。就像霰弹枪发射子弹一样,粒子束会自由地分散开来。调焦使粒子束不至于跑出了真空管。这需要四极磁铁的帮助。此磁铁对活跃的粒子束起作用。同样,一个镜头对 光束起作用。他们起调焦作用,也被称作调焦磁铁。

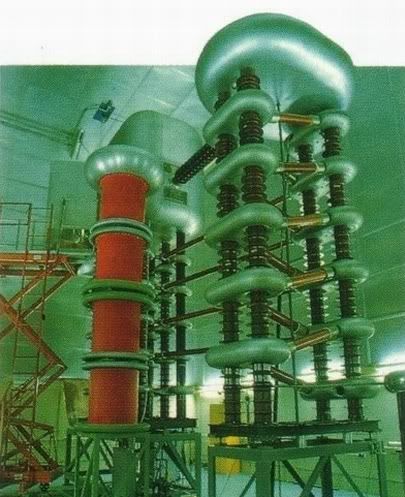

LEP 加速器实景

这些建造粒子加速器的是一些基本的因素。如果您对 CERN 现有的粒子加速器加以观察(像 PS 或 SPS)您将会看到更多的部件,比如:

其它的磁铁(调谐粒子束的轨道)

出入口(粒子束的进出口)

测量设备(把信息反馈给操作员)

安全设备(确保粒子加速过程和粒子加速器的安全)

所有的这些设备都由控制中心控制。这个控制中心就像太空任务的控制室一样!

(欧洲原子核研究组织的粒子加速器)

(德国电子同步加速器--黎飞)

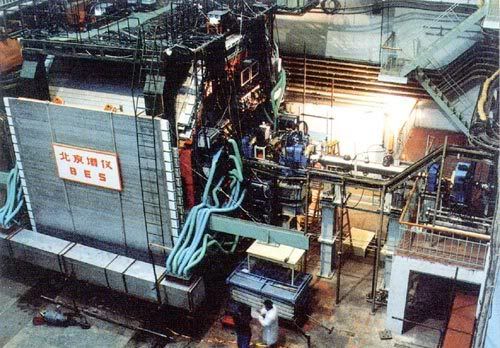

看样子是我国的。。呵呵

[

本帖最后由 TXVF84 于 2007-12-18 22:45 编辑 ]